Cos’è il fenomeno del Deepfake, come difendersi dalle false identità in rete e gli esempi più eclatanti degli ultimi anni.

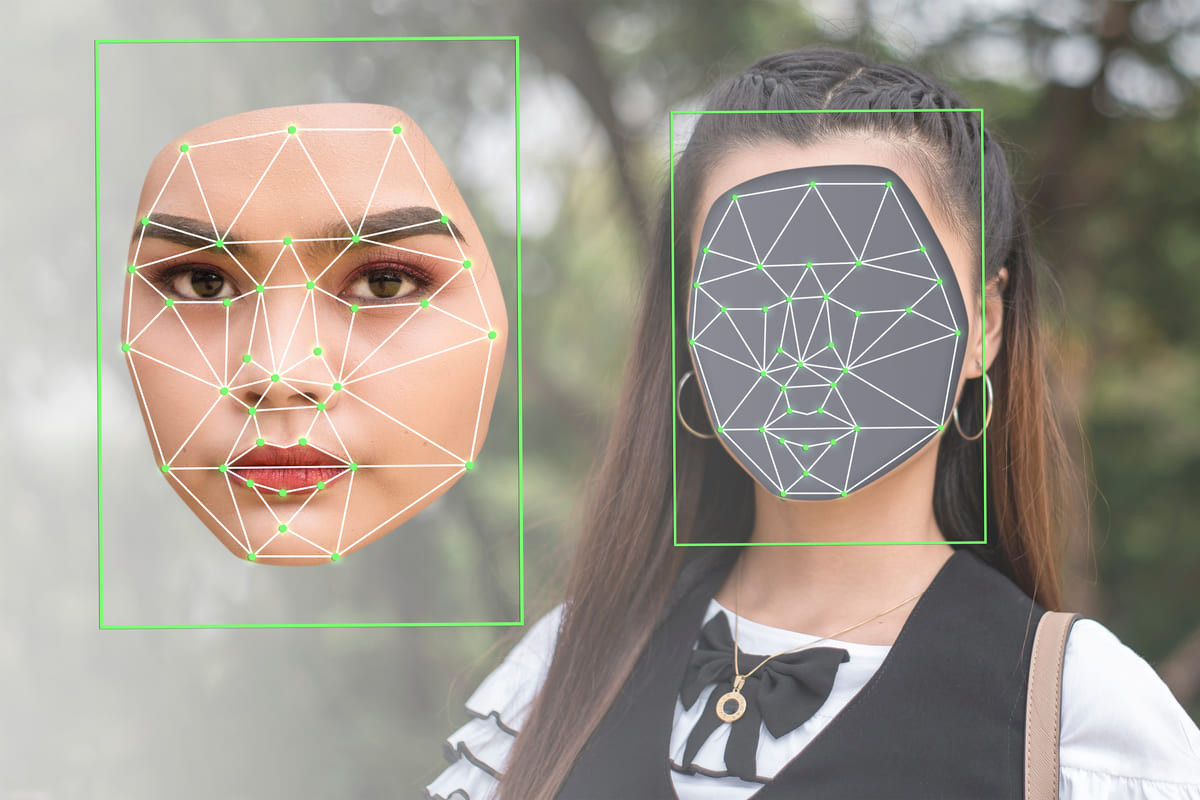

Il termine DeepFake deriva dall’unione di “Deep Learning“, branca avanzata dell’intelligenza artificiale, e “Fake“, che significa falso. Tali contenuti audiovisivi artificiosi, creati tramite algoritmi di AI, sono capaci di modificare o ricreare in maniera estremamente realistica le caratteristiche fisiche e le espressioni di individui, oltre a replicare fedelmente le loro voci, partendo da materiali autentici come foto, video e registrazioni audio.

Come sono realizzati di DeepFake

Il progresso nell’intelligenza artificiale ha portato al miglioramento delle tecniche di elaborazione automatica dei dati, avvicinandosi sempre di più alle capacità cognitive umane.

Tale sviluppo si basa sugli studi di algoritmi che emulano il funzionamento delle reti neurali cerebrali, i quali, attraverso l’addestramento con vasti dataset, correlano specifici input con i relativi output conosciuti.

Di conseguenza, si è fatta avanti la possibilità di generare deepfake sempre più convincenti e minuzionamente dettagliati.

Le principali tipologie di video fake

Esistono divese tipologie di DeepFake, che vi sintetizziamo di seguito:

- DeepNude: questi video manipolati raffigurano persone, spesso senza il loro consenso, in situazioni compromettenti o esplicite, originariamente indirizzati verso figure pubbliche per scopi ricattatori o diffamatori, ma che ora colpiscono anche individui privati, con impatti nocivi a livello sociale e psicologico;

- Cyberbullismo: i deepfake possono essere utilizzati per umiliare o diffamare, specialmente tra i più giovani, creando video denigratori o estorcendo denaro o favori in cambio della non diffusione o eliminazione del materiale;

- Fake News: la creazione di video falsi di politici o leader d’opinione punta a manipolare l’opinione pubblica, soprattutto in contesti elettorali, attribuendo falsamente a queste figure azioni o dichiarazioni compromettenti per influenzare il voto o diffondere disinformazione su temi critici.

I deepfake, inoltre, possono anche avviare minacce alla sicurezza informatica, facilitando pratiche illecite come lo spoofing, il phishing e il ransomware, sfruttando le false identità per trarre in inganno sia individui che i sistemi digitali, compresi quelli basati sul riconoscimento biometrico.

Come difendersi da questa tipologia di attacchi

Nonostante le tecnologie di cybersecurity attuali siano – generalmente – in grado di superare la sofisticazione dei deepfake, è fondamentale mantenere un livello elevato di vigilanza, sia dal punto di vista tecnologico che normativo.

L’informazione e la consapevolezza pubblica giocano un ruolo fondamentale nella prevenzione e nella protezione contro le manipolazioni digitali, insieme allo sviluppo di strumenti di rilevamento sempre più avanzati e alla promulgazione di leggi specifiche per contrastare questo fenomeno che è emerso nel corso degli ultimi anni.

Normative contro i Deepfake a livello nazionale e mondiale

L’escalation del fenomeno deepfake ha catalizzato l’attenzione dei legislatori a livello sia europeo che nazionale, ma anche sul piano internazionale.

Ciò, infatti, ha spinto molto Paesi ad adottare regolamentazioni specifiche per contrastare il fenomeno e le sue relative conseguenze.

Questo crescente interesse normativo ha come obiettivo quello di controllare i rischi associati all’uso improprio dell’intelligenza artificiale nella creazione di contenuti falsificati.

L’Unione Europea, mediante la Commissione Europea, ha introdotto linee guida dedicate all’applicazione dell’intelligenza artificiale, definendo chiaramente i deepfake e promuovendo una politica di trasparenza per l’identificazione dei contenuti alterati o fabbricati. Queste misure sono esemplificate nell’articolo 52, paragrafo 3, delle suddette linee guida.

Al contempo, in Italia, l’Autorità Garante per la protezione dei dati personali ha preso posizione in merito a questa delicata questione, elaborando documenti informativi volti a sensibilizzare gli utenti sui rischi dei deepfake e a proporre pratiche di difesa efficaci.

Strumenti di protezione e compliance

Il settore digitale non è rimasto indifferente a tale sfida e per questo ha iniziato ad adottare misure proattive per contrastare i deepfake e rafforzare la sicurezza informatica. Tale approccio, dunque, prevede il potenziamento delle politiche di compliance, l’espansione delle competenze in ambito di fiducia digitale e la formazione di squadre specializzate in cybersecurity.

In questo contesto, è fondamentale anche scegliere fornitori affidabili, capaci di assicurare transazioni digitali sicure e la continuità delle operazioni, soprattutto se si utilizzano specifici strumenti, quali possono essere la Posta Elettronica Certificata (PEC) e il Sistema Pubblico di Identità Digitale (SPID), essenziali per le interazioni e l’accesso ai servizi pubblici.

I provider di servizi digitali stanno rispondendo a queste sfide anche attraverso partnership strategiche volte a stabilire standard elevati di sicurezza informatica. Un esempio significativo è rappresentato dalla cooperazione tra InfoCert e Tinexta Cyber, che si posiziona come un punto di riferimento nell’ecosistema italiano della cybersecurity.

Gli esempli più eclatanti di DeepFake con personaggi pubblici: da Gal Gadot a Mark Zuckerberg

Gal Gadot fu la prima a subire le conseguenze dei deepfake su Reddit, un fenomeno che la vide, suo malgrado, protagonista insieme ad altre celebrità come Jessica Alba, Taylor Swift e Daisy Ridley, tutte coinvolte in produzioni inappropriate per le quali nessuna delle persone coinvolte aveva espresso il proprio consenso.

La precisione dei deepfake, generata attraverso algoritmi avanzati di face swapping, supera – di gran lunga – le manipolazioni digitali tradizionali: per questo motivo, dunque, i video manipolati diventano strumenti potenti nelle mani di chiunque, in quanto possono essere realizzati, in sostanza, anche da utenti meno esperti e senza avere un bagaglio di competenze specifiche in intelligenza artificiale.

La facilità di accesso a questi strumenti, come dimostra la rapidità con cui software come FakeApp si sono diffusi, fa emergere diverse preoccupazioni sulla loro potenziale diffusione in modo incontrollato, che – in alcuni casi – potrebbe avere anche delle conseguenze molto importanti.

Questi timori non sono infondati, dato che anche figure politiche di rilievo come Barack Obama sono state raffigurate in deepfake estremamente realistici: pertanto, è comprensibile il fatto che la paura di un loro uso improprio in contesti elettorali e oltre possa essere così forte e tangibile.

La manipolazione video di Nancy Pelosi, presentata come ubriaca durante un discorso, evidenzia ulteriormente i rischi associati ai deepfake, che, nei fatti, possono avere anche il potere di ingannare anche figure di spicco e influenzare l’opinione pubblica.

Tale scenario sottolinea la sfida che piattaforme come Facebook affrontano nel distinguere e gestire i contenuti deepfake, problematica resa ancora più complessa dalla dichiarazione di Mark Zuckerberg riguardo alla non rimozione di questi contenuti che – a detta del fondatore del popolare social network – non sono così facilmente riconoscibili.